前言

本文紧接着前一篇的入门教程,会介绍一些关于pandas的进阶知识。建议读者在阅读本文之前先看完pandas入门教程。

同样的,本文的测试数据和源码可以在这里获取: github:pandas_tutorial 。

数据访问

在入门教程中,我们已经使用过访问数据的方法。这里我们再集中看一下。

注:这里的数据访问方法既适用于series,也适用于dataframe。

基础方法:[]和.

这是两种最直观的方法,任何有面向对象编程经验的人应该都很容易理解。下面是一个代码示例:

|

1

2

3

4

5

6

7

8

9

10

|

# select_data.pyimport pandas as pdimport numpy as npseries1 = pd.series([1, 2, 3, 4, 5, 6, 7], index=["c", "d", "e", "f", "g", "a", "b"])print("series1['e'] = {} \n".format(series1['e']));print("series1.e = {} \n".format(series1.e)); |

这段代码输出如下:

series1['e'] = 3

series1.e = 3

注1:对于类似属性的访问方式.来说,要求索引元素必须是有效的python标识符的时候才可以,而对于series1.1这样的索引是不行的。

注2:[]和.提供了简单和快速访问pands数据结构的方法。这种方法非常的直观。然而,由于要访问的数据类型并不是事先知道的,因此使用这两种方法方式存在一些优化限制。因此对于产品级的代码来说,pandas官方建议使用pandas库中提供的数据访问方法。

loc与iloc

在入门教程中,我们已经提到了这两个操作符:

- loc:通过行和列的索引来访问数据

- iloc:通过行和列的下标来访问数据

注意:索引的类型可能是整数。

实际上,当dataframe通过这两个操作符访问数据,可以只指定一个索引来访问一行的数据,例如:

|

1

2

3

4

5

6

|

# select_data.pydf1 = pd.dataframe({"note" : ["c", "d", "e", "f", "g", "a", "b"], "weekday": ["mon", "tue", "wed", "thu", "fri", "sat", "sun"]}, index=['1', '2', '3', '4', '5', '6', '7'])print("df1.loc['2']:\n{}\n".format(df1.loc['2'])) |

这里通过索引'2'可以方法到第2行的所有数据,因此它的输出如下:

df1.loc['2']:

note d

weekday tue

name: 2, dtype: object

除此之外,通过这两个操作符我们还可以访问某个范围之内的数据,例如这样:

|

1

2

3

4

|

# select_data.pyprint("series1.loc['e':'a']=\n{}\n".format(series1.loc['e':'a']));print("df1.iloc[2:4]=\n{}\n".format(df1.iloc[2:4])) |

这段代码输出如下:

series1.loc['e':'a']=

e 3

f 4

g 5

a 6

dtype: int64df1.iloc[2:3]=

note weekday

3 e wed

4 f thu

at与iat

这两个操作符用来访问单个的元素值(scalar value)。类似的:

- at:通过行和列的索引来访问数据

- iat:通过行和列的下标来访问数据

|

1

2

3

4

|

# select_data.pyprint("series1.at['e']={}\n".format(series1.at['e']));print("df1.iloc[4,1]={}\n".format(df1.iloc[4,1])) |

这两行代码输出如下:

series1.at['e']=3

df1.iloc[4,1]=fri

index对象

在入门教程我们也已经简单介绍过index,index提供了查找,数据对齐和重新索引所需的基础数据结构。

最直接的,我们可以通过一个数组来创建index对象。在创建的同时我们还可以通过name指定索引的名称:

|

1

2

3

|

# index.pyindex = pd.index(['c','d','e','f','g','a','b'], name='note') |

index类提供了很多的方法进行各种操作,这个建议读者直接查询api说明即可,这里不多做说明。稍微提一下的是,index对象可以互相之间做集合操作,例如:

|

1

2

3

4

5

6

7

8

|

# index.pya = pd.index([1,2,3,4,5])b = pd.index([3,4,5,6,7])print("a|b = {}\n".format(a|b))print("a&b = {}\n".format(a&b))print("a.difference(b) = {}\n".format(a.difference(b))) |

这几个运算的结果如下:

a|b = int64index([1, 2, 3, 4, 5, 6, 7], dtype='int64')

a&b = int64index([3, 4, 5], dtype='int64')

a.difference(b) = int64index([1, 2], dtype='int64')

index类有很多的子类,下面是最常见的一些:

multiindex

multiindex,或者称之为hierarchical index是指数据的行或者列通过多层次的标签来进行索引。

例如,我们要通过一个multiindex描述三个公司在三年内每个季度的营业额,可以这样:

|

1

2

3

4

5

6

7

8

9

10

11

|

# multiindex.pyimport pandas as pdimport numpy as npmultiindex = pd.multiindex.from_arrays([ ['geagle', 'geagle', 'geagle', 'geagle', 'epple', 'epple', 'epple', 'epple', 'macrosoft', 'macrosoft', 'macrosoft', 'macrosoft', ], ['s1', 's2', 's3', 's4', 's1', 's2', 's3', 's4', 's1', 's2', 's3', 's4']], names=('company', 'turnover')) |

这段代码输出如下:

multiindex =

multiindex(levels=[['epple', 'geagle', 'macrosoft'], ['s1', 's2', 's3', 's4']],

labels=[[1, 1, 1, 1, 0, 0, 0, 0, 2, 2, 2, 2], [0, 1, 2, 3, 0, 1, 2, 3, 0, 1, 2, 3]],

names=['company', 'turnover'])

从这个输出可以看出,multiindex中的levels数组数量对应了索引的级别数量,labels对应了levels中元素的下标。

下面我们用一个随机数来构造一个dataframe:

|

1

2

3

4

5

6

|

# multiindex.pydf = pd.dataframe(data=np.random.randint(0, 1000, 36).reshape(-1, 12), index=[2016, 2017, 2018], columns=multiindex)print("df = \n{}\n".format(df)) |

这里创建出了36个[0, 1000)之间的随机数,然后组装成3行12列的矩阵(如果你对numpy不熟悉可以访问numpy官网学习,或者看一下我之前写过的:python 机器学习库 numpy 教程)。

上面这段代码输出如下:

df =

company geagle epple macrosoft

turnover s1 s2 s3 s4 s1 s2 s3 s4 s1 s2 s3 s4

2016 329 25 553 852 833 710 247 990 215 991 535 846

2017 734 368 28 161 187 444 901 858 244 915 261 485

2018 769 707 458 782 948 169 927 237 279 438 738 708

这个输出很直观的可以看出三个公司在三年内每个季度的营业额。

有了多级索引,我们可以方便的进行数据的筛选,例如:

- 通过df.loc[2017, (['geagle', 'epple', 'macrosoft'] ,'s1')])筛选出三个公司2017年第一季度的营业额

- 通过df.loc[2018, 'geagle']筛选出geagle公司2018年每个季度的营业额

它们输出如下:

2017 s1:

company turnover

geagle s1 734

epple s1 187

macrosoft s1 244

name: 2017, dtype: int64geagle 2018:

turnover

s1 769

s2 707

s3 458

s4 782

name: 2018, dtype: int64

数据整合

concat:串联,连接,级连

append:附加,增补

merge:融合,归并,合并

join:合并,接合,交接

concat与append

concat函数的作用是将多个数据串联到一起。例如,某个多条数据分散在3个地方记录,最后我们将三个数据添加到一起。下面是一个代码示例:

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

|

# concat_append.pyimport pandas as pdimport numpy as npdf1 = pd.dataframe({'note': ['c', 'd'], 'weekday': ['mon', 'tue']}, index=[1, 2])df2 = pd.dataframe({'note': ['e', 'f'], 'weekday': ['wed', 'thu']}, index=[3, 4])df3 = pd.dataframe({'note': ['g', 'a', 'b'], 'weekday': ['fri', 'sat', 'sun']}, index=[5, 6, 7])df_concat = pd.concat([df1, df2, df3], keys=['df1', 'df2', 'df3'])print("df_concat=\n{}\n".format(df_concat)) |

这里我们通过keys指定了三个数据的索引划分,最后的数据中会由此存在multiindex。这段代码输出如下:

df_concat=

note weekday

df1 1 c mon

2 d tue

df2 3 e wed

4 f thu

df3 5 g fri

6 a sat

7 b sun

请仔细思考一下df_concat结构与原先三个数据结构的关系:其实它就是将原先三个数据纵向串联起来了。另外,请关注一下multiindex结构。

concat函数默认是以axis=0(行)为主进行串联。如果需要,我们可以指定axis=1(列)为主进行串联:

|

1

2

3

4

|

# concat_append.pydf_concat_column = pd.concat([df1, df2, df3], axis=1)print("df_concat_column=\n{}\n".format(df_concat_column)) |

这个结构输出如下:

df_concat_column=

note weekday note weekday note weekday

1 c mon nan nan nan nan

2 d tue nan nan nan nan

3 nan nan e wed nan nan

4 nan nan f thu nan nan

5 nan nan nan nan g fri

6 nan nan nan nan a sat

7 nan nan nan nan b sun

请再次观察一下这里的结果和原先三个数据结构之间的关系。

concat是将多个数据串联在一起。类似的,对于某个具体的数据来说,我们可以在其数据基础上添加(append)其他数据来进行串联:

|

1

2

3

4

|

# concat_append.pydf_append = df1.append([df2, df3])print("df_append=\n{}\n".format(df_append)) |

这个操作的结果和之前的concat是一样的:

df_append=

note weekday

1 c mon

2 d tue

3 e wed

4 f thu

5 g fri

6 a sat

7 b sun

merge与join

pandas中的merge操作和sql语句中的join操作是类似的。join操作可以分为下面几种:

- inner

- left outer

- right outer

- full outer

- cross

关于这几种的join操作的含义请参阅其他资料,例如维基百科:join

使用pandas进行merge操作很简单,下面是一段代码示例:

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

|

# merge_join.pyimport pandas as pdimport numpy as npdf1 = pd.dataframe({'key': ['k1', 'k2', 'k3', 'k4'], 'a': ['a1', 'a2', 'a3', 'a8'], 'b': ['b1', 'b2', 'b3', 'b8']})df2 = pd.dataframe({'key': ['k3', 'k4', 'k5', 'k6'], 'a': ['a3', 'a4', 'a5', 'a6'], 'b': ['b3', 'b4', 'b5', 'b6']})print("df1=\n{}\n".format(df1))print("df2=\n{}\n".format(df2))merge_df = pd.merge(df1, df2)merge_inner = pd.merge(df1, df2, how='inner', on=['key'])merge_left = pd.merge(df1, df2, how='left')merge_left_on_key = pd.merge(df1, df2, how='left', on=['key'])merge_right_on_key = pd.merge(df1, df2, how='right', on=['key'])merge_outer = pd.merge(df1, df2, how='outer', on=['key'])print("merge_df=\n{}\n".format(merge_df))print("merge_inner=\n{}\n".format(merge_inner))print("merge_left=\n{}\n".format(merge_left))print("merge_left_on_key=\n{}\n".format(merge_left_on_key))print("merge_right_on_key=\n{}\n".format(merge_right_on_key))print("merge_outer=\n{}\n".format(merge_outer)) |

这段代码说明如下:

- merge函数的join参数的默认值是“inner”,因此merge_df是两个数据的inner join的结果。另外,在不指明的情况下,merge函数使用所有同名的列名作为key来进行运算。

- merge_inner是指定了列的名称进行inner join。

- merge_left是left outer join的结果

- merge_left_on_key是指定了列名进行left outer join的结果

- merge_right_on_key是指定了列名进行right outer join的结果

- merge_outer是full outer join的结果

这里的结果如下,请观察一下结果与你的预算是否一致:

df1=

a b key

0 a1 b1 k1

1 a2 b2 k2

2 a3 b3 k3

3 a8 b8 k4df2=

a b key

0 a3 b3 k3

1 a4 b4 k4

2 a5 b5 k5

3 a6 b6 k6merge_df=

a b key

0 a3 b3 k3merge_inner=

a_x b_x key a_y b_y

0 a3 b3 k3 a3 b3

1 a8 b8 k4 a4 b4merge_left=

a b key

0 a1 b1 k1

1 a2 b2 k2

2 a3 b3 k3

3 a8 b8 k4merge_left_on_key=

a_x b_x key a_y b_y

0 a1 b1 k1 nan nan

1 a2 b2 k2 nan nan

2 a3 b3 k3 a3 b3

3 a8 b8 k4 a4 b4merge_right_on_key=

a_x b_x key a_y b_y

0 a3 b3 k3 a3 b3

1 a8 b8 k4 a4 b4

2 nan nan k5 a5 b5

3 nan nan k6 a6 b6merge_outer=

a_x b_x key a_y b_y

0 a1 b1 k1 nan nan

1 a2 b2 k2 nan nan

2 a3 b3 k3 a3 b3

3 a8 b8 k4 a4 b4

4 nan nan k5 a5 b5

5 nan nan k6 a6 b6

dataframe也提供了join函数来根据索引进行数据合并。它可以被用于合并多个dataframe,这些dataframe有相同的或者类似的索引,但是没有重复的列名。默认情况下,join函数执行left join。另外,假设两个数据有相同的列名,我们可以通过lsuffix和rsuffix来指定结果中列名的前缀。下面是一段代码示例:

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

|

# merge_join.pydf3 = pd.dataframe({'key': ['k1', 'k2', 'k3', 'k4'], 'a': ['a1', 'a2', 'a3', 'a8'], 'b': ['b1', 'b2', 'b3', 'b8']}, index=[0, 1, 2, 3])df4 = pd.dataframe({'key': ['k3', 'k4', 'k5', 'k6'], 'c': ['a3', 'a4', 'a5', 'a6'], 'd': ['b3', 'b4', 'b5', 'b6']}, index=[1, 2, 3, 4])print("df3=\n{}\n".format(df3))print("df4=\n{}\n".format(df4))join_df = df3.join(df4, lsuffix='_self', rsuffix='_other')join_left = df3.join(df4, how='left', lsuffix='_self', rsuffix='_other')join_right = df1.join(df4, how='outer', lsuffix='_self', rsuffix='_other')print("join_df=\n{}\n".format(join_df))print("join_left=\n{}\n".format(join_left))print("join_right=\n{}\n".format(join_right)) |

这段代码输出如下:

df3=

a b key

0 a1 b1 k1

1 a2 b2 k2

2 a3 b3 k3

3 a8 b8 k4df4=

c d key

1 a3 b3 k3

2 a4 b4 k4

3 a5 b5 k5

4 a6 b6 k6join_df=

a b key_self c d key_other

0 a1 b1 k1 nan nan nan

1 a2 b2 k2 a3 b3 k3

2 a3 b3 k3 a4 b4 k4

3 a8 b8 k4 a5 b5 k5join_left=

a b key_self c d key_other

0 a1 b1 k1 nan nan nan

1 a2 b2 k2 a3 b3 k3

2 a3 b3 k3 a4 b4 k4

3 a8 b8 k4 a5 b5 k5join_right=

a b key_self c d key_other

0 a1 b1 k1 nan nan nan

1 a2 b2 k2 a3 b3 k3

2 a3 b3 k3 a4 b4 k4

3 a8 b8 k4 a5 b5 k5

4 nan nan nan a6 b6 k6

数据集合和分组操作

很多时候,我们会需要对批量的数据进行分组统计或者再处理,groupby,agg,apply就是用来做这件事的。

- groupby将数据分组,分组后得到pandas.core.groupby.dataframegroupby类型的数据。

- agg用来进行合计操作,agg是aggregate的别名。

- apply用来将函数func分组化并将结果组合在一起。

这些概念都很抽象,我们还是通过代码来进行说明。

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

|

# groupby.pyimport pandas as pdimport numpy as npdf = pd.dataframe({ 'name': ['a','a','a','b','b','b','c','c','c'], 'data': np.random.randint(0, 100, 9)})print('df=\n{}\n'.format(df))groupby = df.groupby('name')print("print groupby:")for name, group in groupby: print("name: {}\ngroup:\n{}\n".format(name, group)) |

在这段代码中,我们生成了9个[0, 100)之间的随机数,数据的第一列是['a','a','a','b','b','b','c','c','c']。然后我们以name列进行groupby,得到的结果会根据将name列值一样的分组在一起,我们将得到的结果进行了打印。这段代码的输出如下:

df=

data name

0 34 a

1 44 a

2 57 a

3 81 b

4 78 b

5 65 b

6 73 c

7 16 c

8 1 cprint groupby:

name: a

group:

data name

0 34 a

1 44 a

2 57 aname: b

group:

data name

3 81 b

4 78 b

5 65 bname: c

group:

data name

6 73 c

7 16 c

8 1 c

groupby并不是我们的最终目的,我们的目的是希望分组后还要对这些数据进行进一步的统计或者处理。pandas库本身就提供了很多进行操作的函数,例如:count,sum,mean,median,std,var,min,max,prod,first,last。这些函数的名称很容易明白它的作用。

例如:groupby.sum()就是对结果进行求和运行。

除了直接调用这些函数之外,我们也可以通过agg函数来达到这个目的,这个函数接收其他函数的名称,例如这样:groupby.agg(['sum'])。

通过agg函数,可以一次性调用多个函数,并且可以为结果列指定名称。

像这样:groupby.agg([('total', 'sum'), ('min', 'min')])。

这里的三个调用输出结果如下:

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

|

# groupby.pysum: dataname a 135b 224c 90agg sum: data sumname a 135b 224c 90agg map: data total minname a 135 34b 224 65c 90 1 |

除了对数据集合进行统计,我们也可以通过apply函数进行分组数据的处理。像这样:

|

1

2

3

4

5

6

|

# groupby.pydef sort(df): return df.sort_values(by='data', ascending=false)print("sort group: \n{}\n".format(groupby.apply(sort))) |

在这段代码中,我们定义了一个排序函数,并应用在分组数据上,这里最终的输出如下:

sort group:

data

name

a 2 57

1 44

0 34

b 3 81

4 78

5 65

c 6 73

7 16

8 1

时间相关

时间是应用程序中很频繁需要处理的逻辑,尤其是对于金融,科技,商业等领域。

当我们在讨论时间,我们讨论的可能是下面三种情况中的一种:

- 某个具体的时间点(timestamp),例如:今天下午一点整

- 某个时间范围(period),例如:整个这个月

- 某个时间间隔(interval),例如:每周二上午七点整

python语言提供了时间日期相关的基本api,它们位于datetime, time, calendar几个模块中。下面是一个代码示例:

|

1

2

3

4

5

6

7

8

9

10

11

|

# time.pyimport datetime as dtimport numpy as npimport pandas as pdnow = dt.datetime.now();print("now is {}".format(now))yesterday = now - dt.timedelta(1);print("yesterday is {}\n".format(yesterday.strftime('%y-%m-%d'))) |

在这段代码中,我们打印了今天的日期,并通过timedelta进行了日期的减法运算。这段代码输出如下:

借助pandas提供的接口,我们可以很方便的获得以某个时间间隔的时间序列,例如这样:

|

1

2

3

4

5

|

# time.pythis_year = pd.date_range(dt.datetime(2018, 1, 1), dt.datetime(2018, 12, 31), freq='5d')print("selected days in 2018: \n{}\n".format(this_year)) |

这段代码获取了整个2018年中从元旦开始,每隔5天的日期序列。

date_range函数的详细说明见这里:

这段代码的输出如下:

selected days in 2018:

datetimeindex(['2018-01-01', '2018-01-06', '2018-01-11', '2018-01-16',

'2018-01-21', '2018-01-26', '2018-01-31', '2018-02-05',

'2018-02-10', '2018-02-15', '2018-02-20', '2018-02-25',

'2018-03-02', '2018-03-07', '2018-03-12', '2018-03-17',

'2018-03-22', '2018-03-27', '2018-04-01', '2018-04-06',

'2018-04-11', '2018-04-16', '2018-04-21', '2018-04-26',

'2018-05-01', '2018-05-06', '2018-05-11', '2018-05-16',

'2018-05-21', '2018-05-26', '2018-05-31', '2018-06-05',

'2018-06-10', '2018-06-15', '2018-06-20', '2018-06-25',

'2018-06-30', '2018-07-05', '2018-07-10', '2018-07-15',

'2018-07-20', '2018-07-25', '2018-07-30', '2018-08-04',

'2018-08-09', '2018-08-14', '2018-08-19', '2018-08-24',

'2018-08-29', '2018-09-03', '2018-09-08', '2018-09-13',

'2018-09-18', '2018-09-23', '2018-09-28', '2018-10-03',

'2018-10-08', '2018-10-13', '2018-10-18', '2018-10-23',

'2018-10-28', '2018-11-02', '2018-11-07', '2018-11-12',

'2018-11-17', '2018-11-22', '2018-11-27', '2018-12-02',

'2018-12-07', '2018-12-12', '2018-12-17', '2018-12-22',

'2018-12-27'],

dtype='datetime64[ns]', freq='5d')

我们得到的返回值是datetimeindex类型的,我们可以创建一个dataframe并以此作为索引:

|

1

2

3

4

|

# time.pydf = pd.dataframe(np.random.randint(0, 100, this_year.size), index=this_year)print("jan: \n{}\n".format(df['2018-01'])) |

在这段代码中,我们创建了与索引数量一样多的[0, 100)间的随机整数,并用this_year作为索引。用datetimeindex作索引的好处是,我们可以直接指定某个范围来选择数据,例如,通过df['2018-01']选出所有1月份的数据。

这段代码输出如下:

图形展示

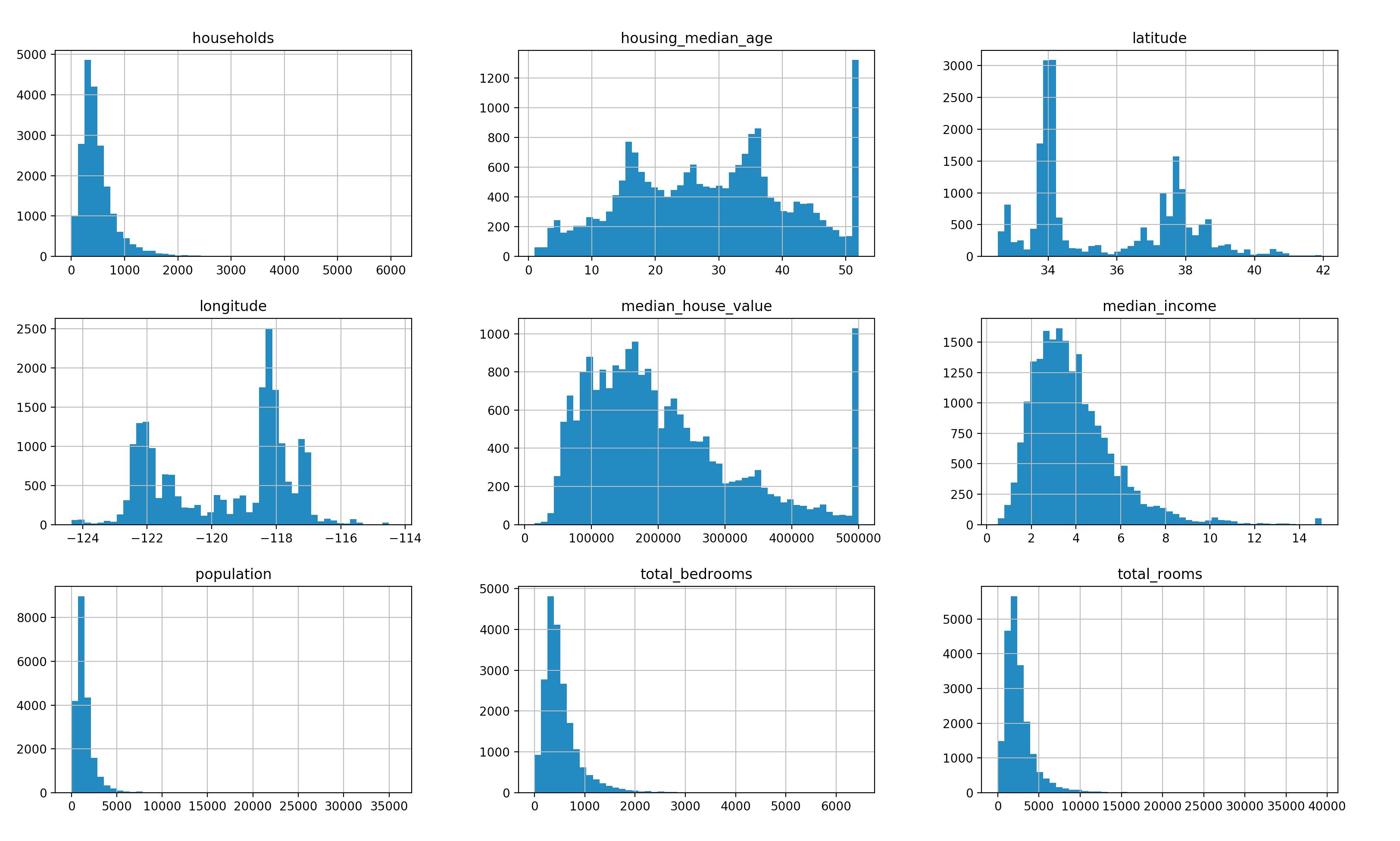

pandas的图形展示依赖于matplotlib库。对于这个库,我们在后面会专门讲解,因为这里仅仅提供一个简单的代码示例,让大家感受一下图形展示的样子。

代码示例如下:

|

1

2

3

4

5

6

7

8

|

# plot.pyimport matplotlib.pyplot as pltimport pandas as pddata = pd.read_csv("data/housing.csv")data.hist(bins=50, figsize=(15, 12))plt.show() |

这段代码读取了一个csv文件,这个文件中包含了一些关于房价的信息。在读取完之后,通过直方图(hist)将其展示了出来。

该csv文件的内容见这里:pandas_tutorial/data/housing.csv

直方图结果如下所示:

结束语

虽然本文的标题是“进阶篇”,我们也讨论了一些更深入的知识。但很显然,这对于pandas来说,仍然是很皮毛的东西。由于篇幅所限,更多的内容在今后的时候,有机会我们再来一起探讨。

读者朋友也可以根据官网上的文档进行更深入的学习。

参考资料与推荐读物

读者朋友也可以根据官网上的文档进行更深入的学习。

原文链接:http://qiangbo.space/2018-03-12/advance_pandas/