下载代码cookie池(这里主要是微博登录,也可以自己配置置其他的站点网址)

下载代码github:https://github.com/python3webspider/cookiespool

下载安装过后注意看网页下面的相关基础配置和操作!!!!!!!!!!!!!

自己的设置主要有下面几步:

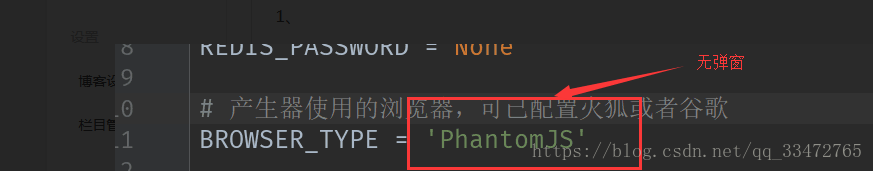

1、配置其他设置

2、设置使用的浏览器

3、设置模拟登陆

源码cookies.py的修改(以下两处不修改可能会产生bug):

4、获取cookie

随机获取cookies: http://localhost:5000/weibo/random(注意:cookie使用时是需要后期处理的!!)

简单的处理方式,如下代码(偶尔需要对获取的cookie处理):

|

1

2

3

4

5

6

7

8

9

10

11

|

def get_cookie(self): return requests.get('http://127.0.0.1:5000/weibo/random').text def stringtodict(self,cookie): itemdict = {} items = cookie.replace(':', '=').split(',') for item in items: key = item.split('=')[0].replace(' ', '').strip(' "') value = item.split('=')[1].strip(' "') itemdict[key] = value return itemdict |

scrapy爬虫的使用示例(爬取微博):

middlewares.py中自定义请求中间件

|

1

2

3

4

5

6

7

8

9

10

11

12

13

|

def start_requests(self): ua = useragent() headers = { 'user-agent': ua.random, } cookies = self.stringtodict(str(self.get_cookie().strip('{|}'))) yield scrapy.request(url=self.start_urls[0], headers=headers, cookies=cookies, callback=self.parse)cookies = self.stringtodict(str(self.get_cookie().strip('{|}'))) yield scrapy.request(url=self.start_urls[0], headers=headers, cookies=cookies, callback=self.parse) |

settings.py 中的配置:

5、录入账号和密码:

格式规定(账号----密码)

6、验证:(注意:使用cmd)

7、使用时注意保持cmd打开运行!!

使用时一定要打开cmd,并运行如第6步。

得到cookie是判断是否处理处理cookie(几乎都需要!!)类比第4步!!!

到此这篇关于python爬虫scrapy框架cookie池(微博cookie池)的使用的文章就介绍到这了,更多相关scrapy cookie池内容请搜索服务器之家以前的文章或继续浏览下面的相关文章希望大家以后多多支持服务器之家!

原文链接:https://blog.csdn.net/qq_33472765/article/details/80957853