本文来源微信公众号“半导体行业观察”,作者李飞。

随着人工智能渐渐落地,人工智能对于算力的需求逐渐增强。本轮人工智能热潮背后的基础是大数据和神经网络,需要海量的数据去训练复杂的神经网络,而训练完成后的神经网络也较为复杂,执行神经网络的推理操作相对于其他基于逻辑规则等智能方案需要更大的计算力。因此,算力成为了人工智能背后的基础资源,而算力的提升则离不开芯片的支持。近日,高通、寒武纪、依图等来自不同背景的明星公司都发布了其用于服务器端的人工智能芯片方案,再加上谷歌、亚马逊、Intel、Nvidia等早已在服务器人工智能芯片领域押注的大公司,我们看到了服务器人工智能芯片的热潮。

服务器AI芯片市场已经有明确需求

人工智能计算一般可以分为两类,即训练和推理。训练是指使用收集到的大量数据去优化神经网络的各项参数,从而能实现最优的精确度。推理则是在训练好的神经网络上将输入数据在各层网络之间做正向传递去求得输出。训练任务和推理任务执行的计算对于计算精度和内存访问的模式都有所不同,因此芯片上往往需要不同的优化。

人工智能芯片根据应用场合也可以分为三个种类:服务器、边缘计算、终端。服务器人工智能芯片主要部署在数据中心的服务器中,执行训练和/或推理任务。服务器人工智能芯片对于芯片的首要需求就是单芯片算力(目前的主流算力在100TOPS级别),其次才会去考虑功耗和成本。边缘计算是指部署在更接近数据源头的服务器上执行的计算,以推理计算为主,典型应用场景包括在自动驾驶汽车上执行自动驾驶算法、在智能销售领域无人店中执行监控和结账操作等等。在边缘计算中,芯片的功耗和成本相对于云端有更严格的限制,而算力则还是多多益善(10TOPS以上)。终端计算则是指直接部署在手机、智能音箱等终端设备上人工智能计算,由于使用电池供电,其对于芯片的首要需求是能效比(1TOPS/W数量级),需要使用尽可能低的能量消耗去完成人工智能计算以保证电池寿命。虽然终端计算对于算力的要求较低(0.1-1TOPS数量级),但是其功耗约束很强,可用的功耗在1W以下,甚至可以低至几十毫瓦级别,同时终端设备对于成本也很敏感。

目前上述三个人工智能应用场景中,边缘计算尚处于概念验证阶段,预计未来几年随着5G和无人驾驶、机器人、智能零售等概念的兴起会出现一批相关芯片公司,但是在今天市场规模还较小。终端人工智能计算目前已经得到初步验证,手机等智能设备都在争相加入人工智能专用处理模块,但是由于其市场对于成本的敏感性,我们预期未来人工智能在终端设备上的形态会以SoC上的IP模块为主,这也就意味着人工智能要么是由高通、海思等智能设备SoC厂商自研集成到自家的SoC中,要么是由第三方以IP的形式授权给SoC厂商,总体来说该市场的利润率并不会太高,还是要以量取胜。

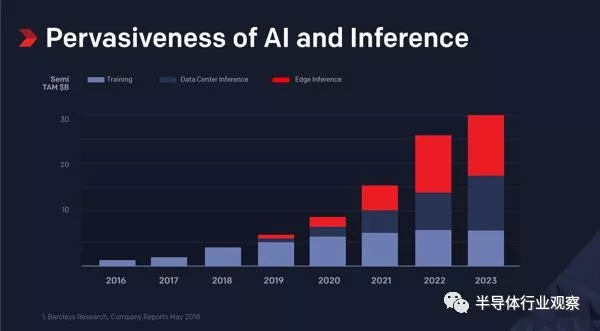

相较而言,服务器端人工智能芯片市场目前已经得到了较好的验证,业务模式和市场规模都已经获得了认可,利润率也较高,因此成为了主流芯片公司的必争之地;而边缘和终端市场在今天来看还主要是针对未来的前瞻性布局。根据Barclays Research的研究报告,服务器端人工智能市场会在未来三年内快速增长,并预计于2021年达到100亿美元的规模;而终端和边缘计算市场则将在三年后才开始真正落地。所以,我们看到了巨头纷纷在今年加码服务器端人工智能芯片。

进入服务器AI芯片市场的几种打法

目前来看,做云端AI芯片的主要有两种厂商,一种是芯片公司,另一种是互联网公司,包括AI公司(如依图)这样的“新物种”。

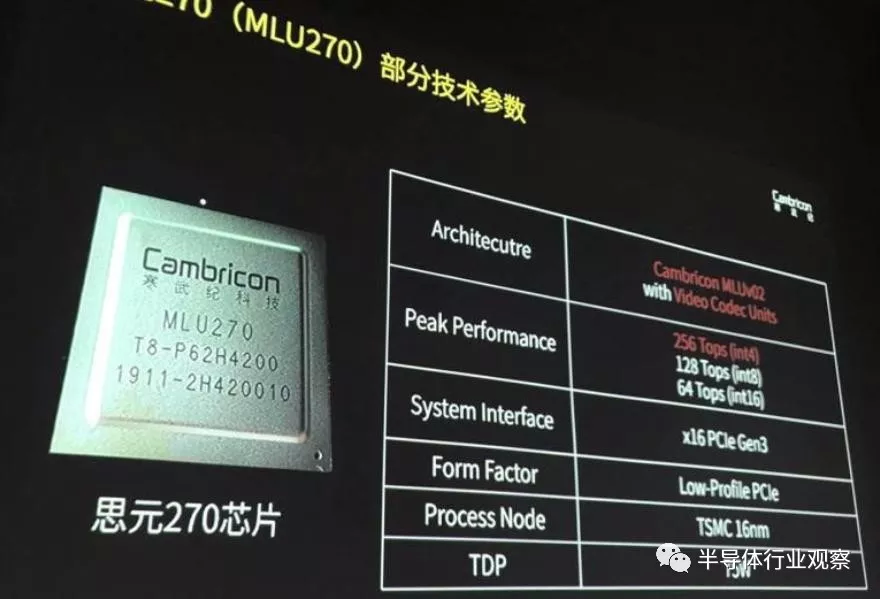

对于芯片公司来说,服务器AI市场的客户往往比较分散,而且每个厂商都有自己独特的诉求,因此需要一家一家谈。由于不同的公司有不同的人工智能技术栈,芯片公司需要能兼容不同公司的需求,有时候甚至需要和客户公司合作开发来确保能满足需求。同时,芯片公司需要在各大公司的需求中寻找到最大公约数,来确保自己的芯片能进入尽可能多的客户中。芯片公司可以直接进入终端客户的服务器中,或者与提供服务器的系统集成商合作,为客户设计满足其需求的服务器来完成销售。例如,中国AI芯片独角兽寒武纪据悉已经获得了滴滴、海康威视等商业客户的直接订单,同时也与浪潮、联想和曙光等服务器系统集成商积极合作来完成服务器的订单。寒武纪于一周前披露的最新思元270芯片使用TSMC 16nm制造,额定功耗75W,其整数计算能力分别为256TOPS(int4)、128TOPS(int8)和64TOPS(int4),这样的设计预计主要针对服务器推理市场,其算力和功耗与Nvidia T4基本相当,基本可以作为Nvidia T4的国产替代,同时寒武纪有位于中国市场离客户近以及性价比的优势,因此想必还是能够拿下大量订单。另外,寒武纪的思元270还集成了视频图像编解码模块,估计其找到的客户“最大公约数”仍然是计算机视觉相关领域,如视频内容分析、安防等。

除了芯片公司向上进入服务器AI市场外,另一类公司则是互联网以及AI公司亲自入场做芯片,例如谷歌、亚马逊以及刚发布自研芯片的中国AI独角兽依图。传统来说,互联网和AI公司主要是服务器和芯片的终端客户,他们的需求是寻找市面上最合适的硬件来运行自己的应用。然而,当市面上的硬件都无法满足这些终端客户的需求时,他们也会亲自做满足自己需求的芯片。

互联网和AI公司亲自做芯片背后的逻辑主要在于建立竞争壁垒。随着AI的落地以及AI对于算力的强烈需求,硬件已经成为AI背后重要的竞争要素。目前,随着市场的充分竞争,各大AI巨头在算法和模型等方面都没有和彼此拉开很大的差距,于是硬件就成为了差异化竞争的重要因素。当模型和算法差距不大时,是否能使用较低的成本部署AI系统并提供良好的用户体验就成了能否拿到用户订单的重要因素了。另外,互联网和AI公司是最清楚自己需求和算法的,因此通过软硬件协同优化可望能实现最优化的系统设计。

上周依图公布的求索就是AI公司入场AI芯片的最新动态。求索SoC完全结合依图的算法做优化,只支持int8操作,主要针对视觉应用,例如人脸识别、车辆检测、视频结构化分析等任务。配合依图的算法,使用四块求索芯片的依图原子服务器算力和使用八块Nvidia P4的服务器相当,而体积仅为P4服务器的一半,功耗则低至20%,从而能大大减少部署的难度。更关键的是,目前一块Nvidia P4的市价为2000美元左右,而求索芯片板卡的成本我们预计可以做到100美元以下,因此可以帮助依图进入更多的客户。相比使用Nvidia GPU的其他竞争公司,依图的算法配合自研的芯片确实是一个很强的竞争优势。

未来服务器AI芯片竞争格局预估

随着服务器端AI市场的真正落地,越来越多的厂商开始真正投入该市场,Nvidia的垄断难度也越来越大。如前所述,新进入服务器AI芯片战场的厂商要么拥有芯片背景,或者是互联网/AI公司亲自做芯片。服务器AI市场的特殊性在于不同垂直应用对于芯片的需求有较大不同,而使用目前的主流芯片架构做一款能兼容大多数应用的芯片往往性能不够好,因此芯片厂商还是需要认准一些重要的垂直应用,并且在垂直应用中打下站稳脚跟之后再考虑去横向扩展。对于互联网/AI公司造芯来说,由于他们对于垂直应用的前景非常清楚,因此主要就是看自研芯片对于竞争壁垒的构建有多少帮助,是否值得投入资金真正做芯片。在设计服务行业越来越成熟的今天,造芯的成本会逐渐降低,因此我们预期看到越来越多的互联网和AI公司加入自研芯片的行列。因此,服务器AI芯片的竞争格局我们预期在未来几年会看到Nvidia凭着CUDA生态的优势仍然占据通用芯片的主流地位,但是其市场份额将会被其他芯片公司和客户公司慢慢蚕食,同时在云端数据中心FPGA也会占据一部分市场。

服务器AI芯片竞争的变数在于下一代技术。目前冯诺伊曼架构的加速器的架构潜力已经被挖掘得很充分,之后难以再期待数量级上的提升,因此能带来重大变革的当属下一代技术。下一代技术还拥有不少不确定性,但是我们也看到了不少新技术拥有巨大的潜力,例如使用光技术做计算的LightIntelligence,可以实现超低延迟超低功耗计算。